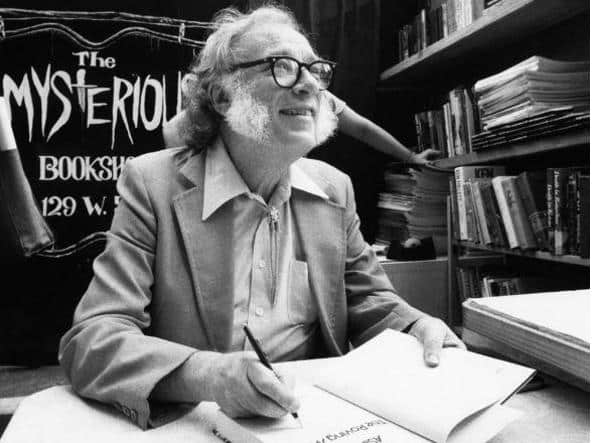

人工知能の爆発的普及と、古典的な「宗派」への分裂 高貴な と 大惨事 (何らかのバランスは決してありませんが)AIの倫理に関する議論が再燃しています。正直に言うと、何十年も生き続けているトピックです。 「ロボット」という言葉が考え出されて以来、機械が人類を滅ぼさないように制限する方法について疑問が投げかけられてきました。覚えていますか?アシモフについて読んでから出発しましょう。

アイザック・アシモフの著作とその法則

これらは、テクノロジーを制限する方法についての考察の最も有名な例です。アイザック・アシモフのロボット工学の法則は、物語「ランアラウンド」や「アイ、ロボット」などの作品で、安全対策としてすべての人工知能に組み込まれています。

誰かが現実でもうまくいくだろうと自分を欺いたり、同様の解決策を思いついたりしました。 それはそうではありません。手短に説明します。アシモフの法則は現実ではなく、現実にそれらを実装する方法はありません。 ミッドジャーニーでもわかるように、それらはすでに紙くずです。

覚えていますか? 見直してみましょうか?

アシモフの法則は次の XNUMX つです。

- 第一法則: ロボットは人間に危害を加えたり、不作為によって人間に危害を加えたりすることはできません。

- 第二法則: 第一法則に反しない限り、ロボットは人間の命令に従わなければなりません。

- 第三法則: ロボットは、第一法または第二法に違反しない限り、自らの存在を守らなければなりません。

アシモフの最も熱心な読者は、1985 年に小説『ロボットと帝国”。と呼ばれる ゼロの法則 そして次のようになります:

ロボットは人類に害を及ぼすことはできませんし、何もしないことで人類に害を及ぼすことを許すこともできません。

アイザック·アシモフ

もうそれらは忘れてください。

アイザック・アシモフは 40 年代に執筆と推論を始めましたが、AI が害を及ぼすのを防ぐために特定の法則を使って AI をプログラムする必要があることをまったく理解していませんでした。彼はまた、これらの法律が機能しないことにも気づいていました。

いとこ 倫理上の問題は複雑すぎて、単純に「はい」か「いいえ」で答えることができない場合。 二番目 それは本質的に非倫理的であり、知覚を持つ人々に奴隷であり続けることを要求します。 第XNUMX なぜなら、それは永続的な社会階層化を伴い、膨大な量の搾取の可能性を伴うからである。 そしてその ゼロの法則? それ自体は失敗しますし、他のすべての場合も失敗します。

要約: アシモフの法則は、人工知能の倫理について考えるための興味深い出発点を示していますが、現実の世界では、より具体的で適応可能な解決策が必要です。

クオリ?

専門家は、AI が安全かつ倫理的であることを保証するために、さまざまな方向から調査を行っています。主なものは次の 4 つです。

- 透明性と説明可能性: AI が特定の決定を下す方法と理由をユーザーが理解できるように、アルゴリズムは透明性があり説明可能である必要があります。

- 人間の価値観と偏見: AI システムは、人間の基本的な価値観を尊重し、望ましくない偏見を減らすように設計される必要があります。これには、多様なデータセットでのトレーニングや、AI による意思決定がさまざまな人々のグループに及ぼす影響の分析が含まれます。

- セキュリティと信頼性: これは自明の理です。 誤動作やサイバー攻撃のリスクは避けなければなりません。

- 管理と責任: 人工知能によって実行されるアクションの責任者を確立し、問題が発生した場合の結果を割り当てることが重要です。

これらの「新しいアシモフ法」(アシモフのものではない)に、世界的な規制と倫理基準を追加する必要があります。これが、宗派主義ではなく、人工知能の開発に関して国際協力が必要な理由です。

AIの「父」の一人であるジェフリー・ヒントンは、 彼は定義しました 人工知能を「新型原爆」と呼ぶ。私は同意しません、 そして私は一人ではありません。 しかし、そうなる可能性はありますが、それは人工知能ではなく私たちのせいです。特に、最初にそれを他者に対する「クラブ」として考えた場合はそうです。

アシモフの朗読、さようなら。 新しい法律、急いでください

最初の 自動運転車、確かに、半自律型はすでに人を不注意で殺す「力」を持っています。キラードローンのような兵器は実際に人を殺すことさえできる 自律的に行動する。はっきり言っておきますが、AIは現時点では法律を理解することはおろか、法律に従うこともできません。

人間の行動のエミュレーションはまだ十分に研究されておらず、合理的な行動の開発は限定的で明確に定義された領域に焦点を当ててきました。非常に重大な欠点が 2 つあります。なぜなら、それらによって知覚を備えた AI (現時点では強調します) が可能になってしまうからです。 存在しない それにも関わらず 彼らが言うことよりも そのピグマリオンは存在するかどうかわかりません)あらゆる兆候を解釈しません。 そして、簡単に二言言えば、制御不能になってしまいます。

このためにどれだけ時間があるか分かりません。一年、十年、永遠。アシモフの法則と同様に、AI が人間に危害を加えるのをどうやって防ぐかという問題は、誰かが今すぐ解決する必要があることはわかっています。

スカイネットは単なるフィクションですが、フィクションでは私たちに逃げ場を与えてくれませんでした。 そしてご存知のとおり、SF は未来を予測するものではありませんが、多くの場合、未来にインスピレーションを与えます。