私たちは狂ってしまいました。みんな。人工知能(AI)が普及し、新聞紙面やメディアにパニックが広がっています。そしてそれは、この現象に関するあらゆる分析(たとえバランスの取れたものであっても)に対して、恐怖と攻撃的なコメントで終わります。この破滅的な状況の背後にあるものは何でしょうか?

カタストロフィズム: 伝染病のようなもの

当初、それはセンセーショナルでしばしば根拠のない記事で知られるタブロイド紙でした。今日、ニューヨーク・タイムズのようなさらに「真面目な」新聞も大惨事の波に乗り始めており、このテーマに関する議論がさらに盛り上がっている。

AI の世界そのものの一部の主要人物は、私たちが皆さんにお知らせしたとおり、恐怖を利用して知名度と注目を集めることで、これらの終末論的なシナリオの拡散に貢献しました。

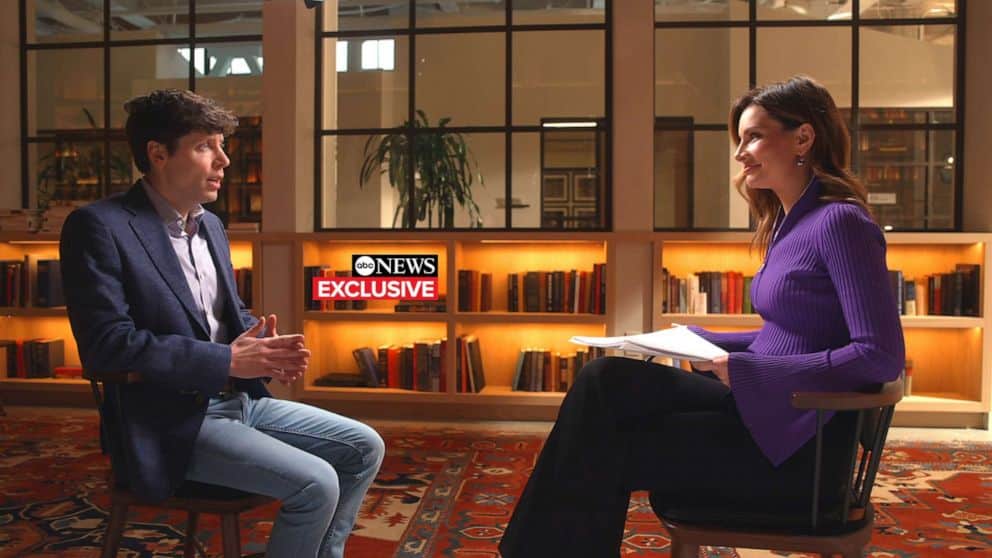

これらの間で、 Sam Altman、OpenAI の CEO がその好例です。 彼の声明 彼らは、AI が人類にとって致命的な危険となる可能性がある、暗く不穏な未来を描きました。その後、彼は次のような発言を繰り返した。 エリーザー・ユドコウスキー、別の超専門家、娘が大人にならないのではないかと心配している:実際、彼によれば、その前にAIは それは私たち全員を殺す可能性があります.

ルディズムを活用してテクノロジーを促進する

なぜこれらの人々や組織が AI に関してパニックを煽っているのかという疑問が生じます。それは本物の「慈善活動」なのでしょうか(さらに、AIを開発し、すでにAIで稼いでいる人々の側で)。

答えは簡単です。テロは売れるからです。たとえば、OpenAI の製品に対する恐怖の風潮を作り出すことは、同社のマーケティング戦略の不可欠な部分です。自社の製品が「人類史上最も重要かつ恐ろしい」ものであると人々に信じ込ませることは、一般大衆、投資家、潜在的な従業員の注目を集めます。

2019 年、同様のゲームにより、ソーシャル メディアはもう少し酸素を確保しました。 EU離脱と2016年のトランプ大統領選挙の原因がケンブリッジ・アナリティカのせいだとする誤った情報に対する継続的な警告は、実はFacebookのセールスメッセージを裏付けていた。 誰でも説得できる すべての?"

あなたの中で誰がこのパターンを把握しましたか? 正直に言ってください。

ビジネスの大惨事

それは誰にとっても便利です。AI 企業にとっても、そして恐るべき「自由のチャンピオン」にとっても。一方で、サム・アルトマンのような人物は、終末論的なマーケティングを利用して実際の製品を宣伝しています。その一方で、AIの大惨事を主力商品、キャリア、収入源とする「保守派ヒーロー」が増えている。

例? 「」の旗手たち効果的な利他主義”。彼らは、仮説上のAGI(汎用人工知能)の黙示録から私たちを救うことができる選ばれた少数の者であると主張しています。しかし、彼らはそれでお金を稼いでいます。そして、彼らは売れます。製品、サービス、書籍、イベント。彼らの投稿は何百万ものクリックを受けます。最も怠け者に降りかかるマントラは、同じパッパルデッレです。同じキーワード:「ああ!トランスヒューマニズム!」 「ああ!オヴァートンの窓」。いくつかの混乱したアイデアは、AI の本当のリスクと本当の機会に関する真の健全な議論を妨げることになります。

制御不能。 それは場違いです。

AI に関するヒステリックな破局主義が、さらにもう 1 つの主流製品になりました。そして多くの自称「目覚めている」人々は、自分たちが実際には、それなりに別の群れの一部であることを理解していません。これらのメカニズムを認識し、集団ヒステリーに圧倒されないことが重要です。

人工知能は確かに課題や懸念をもたらしますが、パニックに陥るのではなく、合理的で証拠に基づいたアプローチでそれらに対処することが不可欠です。

大惨事から文明化までの 5 つのステップ

AI に関する集団ヒステリーやパニックと闘うには、次のことが重要です。

- 一般の人々を教育する:AI とそのアプリケーションに関する正確でアクセスしやすい情報を広めることは、人々がこれらのテクノロジーによってもたらされるリスクと機会をより深く理解するのに役立ちます。私たちは努力しています。

- 専門家と一般市民の間の対話を促進する: 科学者、エンジニア、業界の専門家が一般の人々と交流し、AI に関する知識を共有する機会を作ることで、このテーマへの理解を深め、不当な大惨事を減らすことができます。

- 責任あるメディア報道を奨励する: AI に関する世論の形成において、メディアは重要な役割を果たしています。よりバランスの取れた事実に基づいたメディア報道を奨励することで、集団ヒステリーを軽減し、AI 関連の問題についてのより合理的な議論を促進することができます。

- 国際協力の促進: この態度が純粋に警戒心が強いと考えている「賢い」キーボード奏者は、AI に対するパニックが軍縮ではなく軍備競争を煽る可能性があることを知るべきです。代わりに、AI における国際協力を促進することで、これらのテクノロジーが責任を持って開発および規制され、その利益が世界的に共有されるようにすることができます。

- 明確で公正な規制の枠組みを構築する:堅牢で明確に定義された規制の枠組みは、AI の悪用を防止し、これらのテクノロジーが倫理的かつ責任を持って使用されるようにするのに役立ちます。もちろん、ChatGPTのイタリアの事例のように、これらのルールが大惨事やヒステリーによって左右されないことが重要です(おしゃべりを超えて我が国に従う人がいないのは偶然ではありませんが、適切な時間をかけて評価しています)。むしろ、AI のリスクと機会についての深く合理的な理解に基づいた選択が必要です。残りは、なんと、AI イベントを企画して金儲けをしたいマーケターにとっての資料となる。いざというとき。

付録は真の犠牲者に捧げられています

この長い記事の最後の部分を、この状況に本当に苦しんでいる人々に捧げたいと思います。ほんの少しは精神的な怠惰によるもの、少しは態度によるもの、そして多くは自分自身以外の欠点によるものです。このニュースに直面して、破局主義を受け入れ、それを誇りの源に変え、ほとんど自由のための戦いに変えた人々。

ソーシャル チャネルでは、タイトルを読んでそれらを認識し、キーワード (この場合は「人工知能」) を読むことでアクティブになり、パブロフの反応と私が話したマントラから始まります。もしかしたら、侮辱や脅迫が散りばめられているかもしれません。

私はあなたに話しかけます

皆さん、大惨事の預言者にならないでください。恐怖を説かないでください。何よりも、おこがましくも自分を「人工知能の悪からの救世主」(そしてトランスヒューマニズム。それとは何の関係もないことはわかっていますが、パセリのようにあらゆるものに付け加えます)のレベルに置くのはやめてください。

操作される危険があります。かしこまりました。あなたが嘲笑したり非難したりしている人たち、あなたの観点から見ると「主流派の言うことをすべて受け入れる」人たちとまったく同じです。

メインストリームも恐怖で操る、それを知るべきだ。 代わりに、この技術のリスクと利点のバランスを取りながら、このトピックを一緒に深く掘り下げてみませんか?

大惨事を放棄することが、起こり得る大惨事を回避する最善の、そしておそらく唯一の方法です。 ああ、言いましたね。