Nvidia、人工知能の世界を征服した GPU の巨人は、勢いが衰える気配を見せません。それどころか、 プレゼンテーションと一緒に 新しいの ブラックウェル B200 GPU そして GB200 の「スーパーチップ」は、競合他社とのリードをさらに拡大するつもりのようです。

これらのコンピューティングパワーのモンスターは、 すでに優れた H30 よりも最大 100 倍のパフォーマンスを備えています、AI の地平を再定義し、ますます戦略的で競争力が高まるセクターにおける Nvidia の優位性を強化することを約束します。

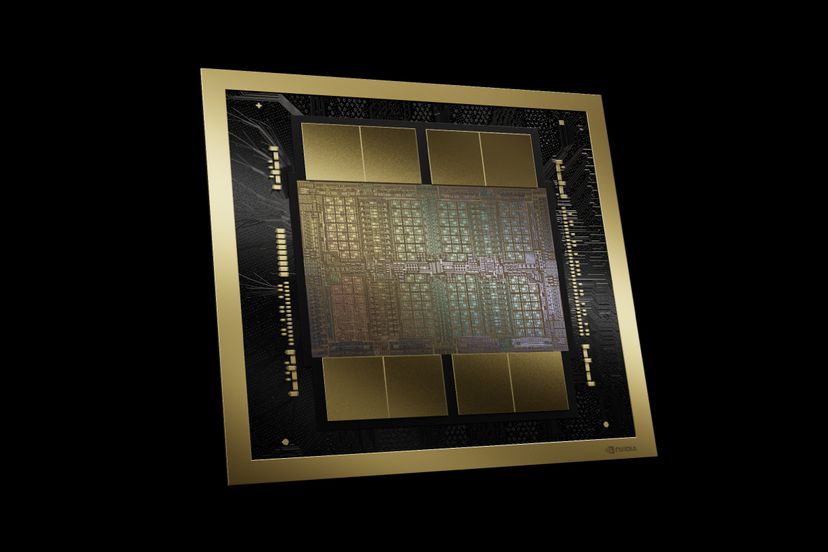

Blackwell B200、208 億個のトランジスタ、20 ペタフロップスの純粋な電力

数字を見ると頭がクラクラします。 新しい B200 GPU は、なんと 208 億個 (そう、数十億個) のトランジスタを 20 つのチップに詰め込み、最大 4 ペタフロップスの 4 ビット浮動小数点 (FPXNUMX) 演算能力を解き放ちます。参考までに、これは に匹敵する力です。 20 万台のハイエンド ラップトップ。 これらすべてが、はがきサイズの 1 つのチップに収められています。

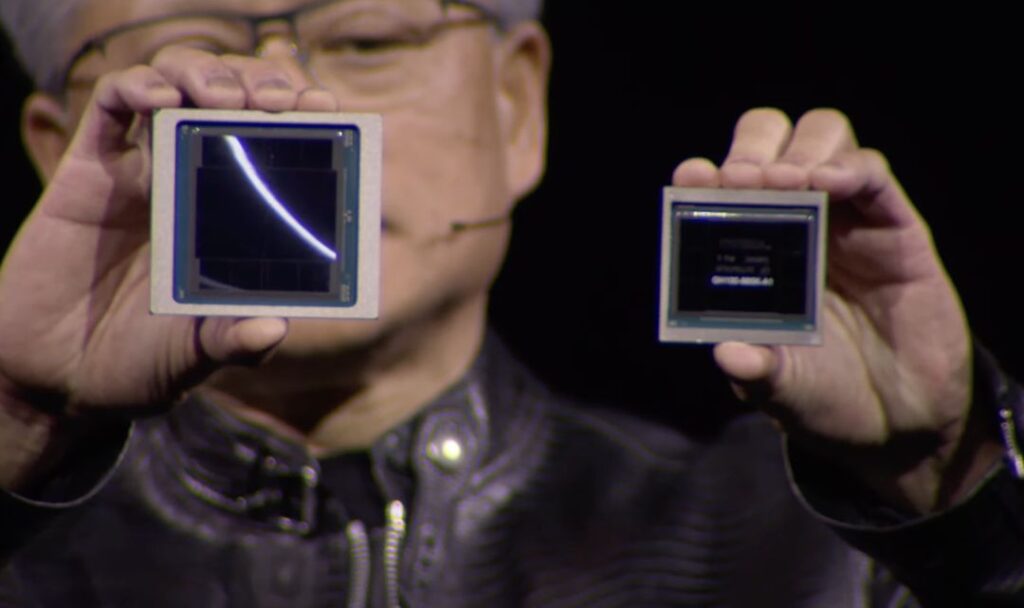

しかし、Nvidia の本当のエースは Blackwell GB200 です。Blackwell GB200 は、30 つの B30 GPU と Grace CPU を 100 つのパッケージに融合した「スーパーチップ」です。この 25 ペタフロップスの猛獣は、大規模言語モデル (LLM) 推論タスクで HXNUMX の最大 XNUMX 倍のパフォーマンスを実現し、コストと消費電力を XNUMX% 削減することが約束されています。 2 つの単語で: より多くの電力、より少ない費用、より少ない環境への影響。 はい、単語は7つありました。

1 つのチップでは不十分な場合は、「トランス エンジン」が処理します。

Nvidia はどのようにしてこのすべてのパワーを引き出しているのでしょうか?秘密の 1 つは、第 2 世代の「トランスフォーマー エンジン」にあります。これは、ますます大規模で高性能なニューラル ネットワークを実現するために、コンピューティング能力を 2 倍にし、より多くのニューロンをより少ないスペースに配置する専用アーキテクチャです。

これらのチップを何十、何百もサーバーにまとめたらどうなるでしょうか?最大 576 個の GPU が、1,8 秒あたり XNUMX テラバイトの双方向帯域幅で相互に「通信」できます。 3 つの言葉で言えば (今度は本当に誓います): 究極の並列コンピューティング。

チップからスーパーコンピューターまで、短いステップで実現

私たちがすぐに目にするものについて知りたい場合は、これらのブラックウェルによって駆動されるシステムは、27 兆のパラメーターを使用してモデルをトレーニングできるようになります。 GPT-4 は「わずか」 1,7 兆 XNUMX 億を誇ります。

Nvidia は AI の世界全体に挑戦を開始しているようです。速く進みたいですか?私たちに従ってください。そして、大手クラウド企業もそのメッセージを理解しているようだ。Amazon、Google、Microsoft、Oracle はすでに、自社のサービスでこれらの装飾品を提供するために提携している。これは、コンピューティング能力に対する渇望がこれまで以上に高まっていることを示しています。

ブラックウェルのせいで、NVIDIA は市場を潰すことになるのでしょうか?

Nvidia のこの過剰な力に鼻を鳴らす人もいます。人工知能などの主要分野で事実上の独占が生まれる危険性があります。質問するのは良いことです。この「より大きく、より速く、より強力に」を目指す競争が、ますます複雑で予測不能な AI システムの無制御な開発につながるのではないかと懸念する人もいます。これも当然の質問です。

なぜなら、これらの疑問符を超えて、NVIDIA は Blackwell と GB200 によって、イノベーションのアクセルを踏んでいることを実証したからです。悪い。そして、それを削除するつもりはありません。

好むと好まざるにかかわらず、AI の将来はますます GPU の言語を話すようになります。そして彼はジェンセン・ファンのような陰険な顔をしています。