昔々、XNUMX人の美しい兄弟、実際にはXNUMX人のモデルがいました。真剣に、一方はもう一方よりも美しいですが、それは私があなたに話したい最初のことです。 その間、それらを紹介させてください。

XNUMXつは呼ばれました GPT-3、およびテキストの生成を担当しました。 彼はそれですべての中で最高でした。 非営利団体 OpenAIイーロンマスクとサムアルトマンによって設立された、人類の利益のための人工知能の研究を促進するためにそれを作成しました。

もう一人の兄弟はグーグルと呼ばれていました GMP-3、そして彼は本当のモデルでした。 言語学、つまり。 言語モデルは、前の単語に基づいて次の単語を予測するメカニズムです。 携帯電話のT9機能と同様に、自動検出アプローチを使用しており、多くのページのテキストを生成できます。

In 彼らはどちらの方法で惑星を導くつもりでしたか? 今、私はあなたに言います。 それまでの間、XNUMXつのモデルのより美しいモデルについて話しましょう。

なぜGPT-3がもっと美しかったのですか?

まず第一に、GPT-3は、2億のパラメーターで訓練された2019年に生まれた父親のGPT-1,5よりもハンサムで筋肉質でした。 そして、2018年に117億3万のパラメーターでトレーニングを受けた彼の祖父であるGPTについてはお話ししていません。 GPT-175は、XNUMX億のパラメーターについて訓練され、考えており、他の誰もできないことを行うことができました。 彼は問題を解決し、詩や散文、ニュースやブログの記事を書きました(たとえば、私もこれを書いていませんか?)。 そのためには、何を書くべきかについての簡単な説明と、おそらくいくつかの例が必要でした。

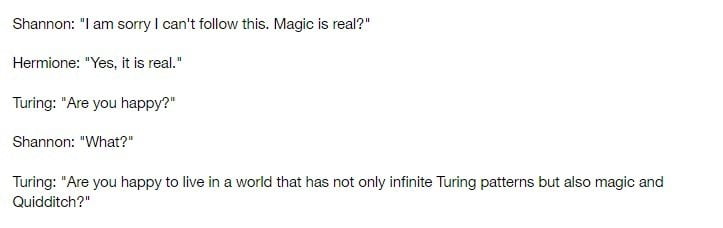

それだけではありません。多くの本を研究してきたGPT-3は、あらゆる歴史上の人物のように見える可能性があります。 彼はヘーゲルのように話し始め、本当の哲学者と同じように意見を述べることができました。 または、XNUMX人の科学者(アランチューリングとクロードシャノンのように)とハリーポッターのキャラクターの間の会話全体を書きます。

彼はどうやってそれをしましたか?

彼を訓練するために、GPT-3の開発者は本当にすべてを使用しました。 たとえば、すべての英語版ウィキペディア、さらには小説やWebページもあります。 新聞記事、詩、 プログラミングガイド、ファンフィクション、宗教的なテキスト。 ラテンアメリカに関する情報、または疑似科学の教科書や陰謀のエッセイですら。

GPT-3は、前述のように、自動検出に基づいて動作しました。 ユーザーがテキストを入力すると、モデルは言語を調べ、テキスト予測子を組み込んで、可能性の高い結果を生成しました。 さらに調整やトレーニングをしなくても、モデルは実際の人が書くものに非常に近いテキストを生成しました。

そして、物語はどのように終わりましたか?

私はまだGPT-3がするすべてのことについて話すことができました 彼は作った。 たとえば、GPT-3は、仕事を簡単にすることで、人々がより重要なタスクに集中できるようになっていることをお伝えできます。 これは、人間の雑用を減らすことによって人間のパフォーマンスに影響を与える能力を示しました。 エンターテインメント、個人の成長、ビジネス、科学研究、工学、経済学、政治プロジェクトの計画と実施をどのように可能にしたか。 ある日、彼がどのようにして感性になり始めたか。

しかし、真実は、話はまだ終わっていないということです。 実際、それはまだ始まったばかりです。これまでに見た中で最も美しいモデルであるGPT-3は急速に大きく成長しており、すぐにお父さんになる可能性があります。 GPT-4が何を達成できるかについて漠然とした考えさえありますか?