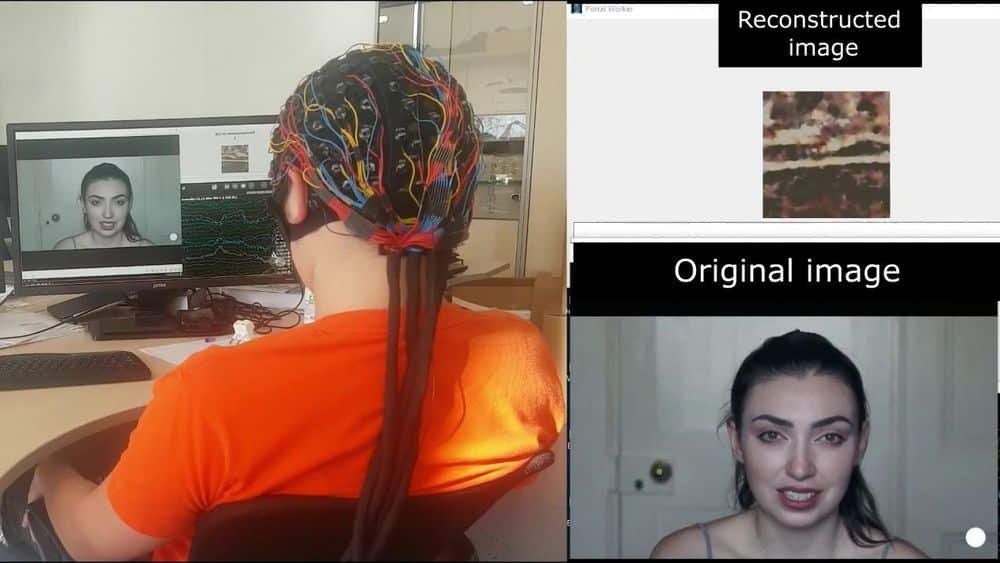

研究チームは、脳波を読み取ってデコードするだけで、人がリアルタイムで見ているものを引き出す人工知能を作成しました。

最も重要なことは、それが非侵襲的な手法であり、脳波(EEG)に接続されたイヤホンで脳波に関するすべての情報を収集およびコーディングできることです。

「研究者たちは、EEGを使用して脳のプロセスを研究することは、タバコの煙を分析して人の形を推測しようとするようなものだと考えていました。」 研究者は言います グリゴリー・ラシュコフ リリースで。 「人間が見た画像を部分的に再構成するのに十分な情報が含まれるとは予想していませんでした。しかし、それは完全に可能であることが判明しました。 「

検索

モスクワ物理技術研究所とロシアの会社であるNeuroboticsのメンバーで構成される混合チームは、脳波を記録できる電極付きの特別なヘッドギアを配置することから研究を開始しました。

20番目のフェーズでは、各参加者が、それぞれ10秒間続く5分のビデオフラグメントをXNUMXつのカテゴリに分けて観察しました。 最初の数回のセッションの後、研究者たちは、彼らの脳波データを見ただけで、ボランティアが見ているビデオのカテゴリーを知ることができることにすでに気づいていました。

第XNUMX段階では、科学者はXNUMXつのニューラルネットワークを開発しました。 XNUMXつはXNUMXつのビデオカテゴリの画像を生成するようにトレーニングされ、もうXNUMXつはEEGデータを同等のノイズに変換するようにトレーニングされています。 競争において、XNUMXつのGANネットワークは驚くべき画像を生成しました。

「今日のテクノロジーにより、侵襲的なニューラルインターフェース Elon Muskの会社であるNeuralinkが開発中のものなど、複雑な手術と自然なプロセスによる急速な悪化の課題に直面しています。 インプラントは数か月で酸化して機能しなくなる可能性があります。 "、 サイコロ ラシュコフ.

「この研究では、インプラントを必要としない、より費用対効果の高いニューラルインターフェースを設計することを目指しています。」