無表情な顔からあなたの政治的志向について何が分かるでしょうか?人工知能を使用して顔写真から政治的指向を予測した最近の研究によると、想像をはるかに超えています。年齢、性別、民族などの変数を制御した場合でも、顔認識アルゴリズムは人間と同等の精度で政治的信念を推測することができました。 しかし、この発見はデジタル時代の私たちのプライバシーにどのような影響を与えるのでしょうか?

顔認識: 良い点と悪い点

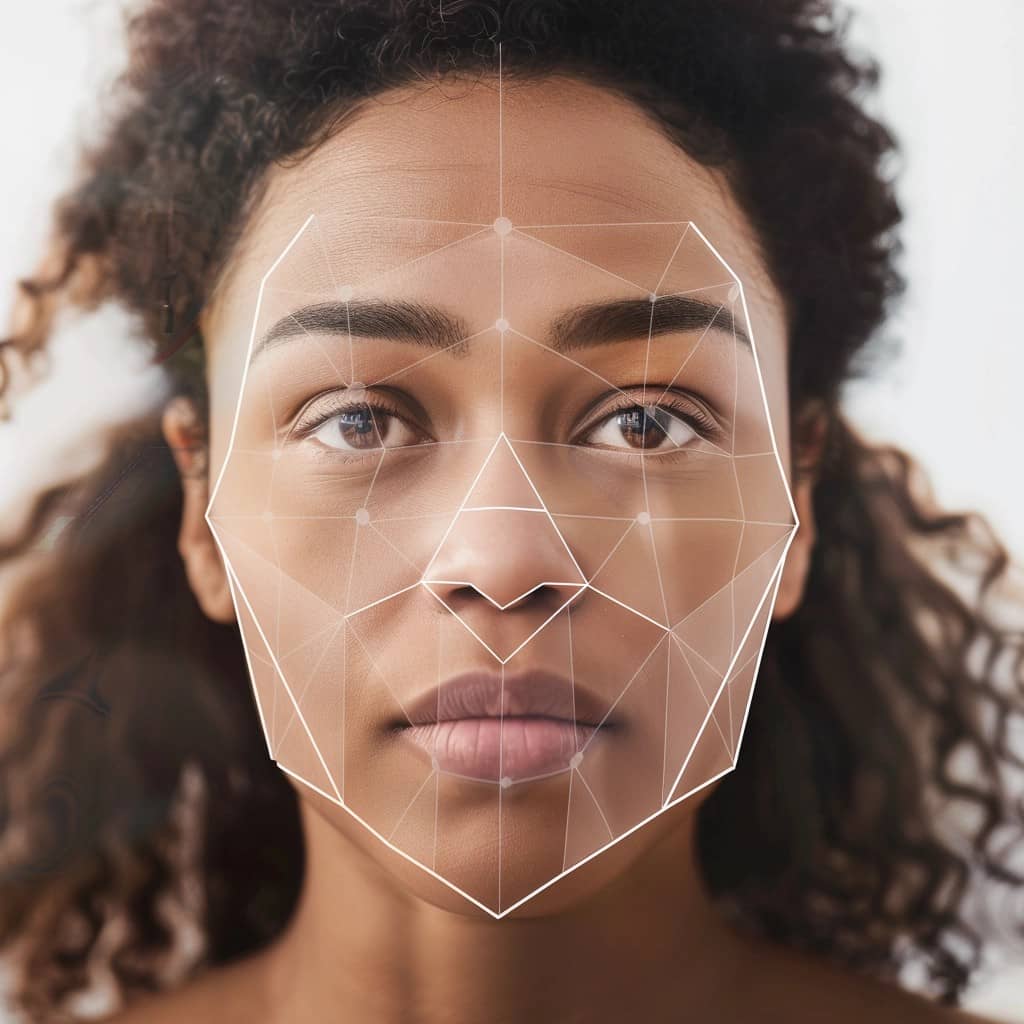

Il 顔認識 は、顔の特徴に基づいてパターンを分析することで個人を識別し、認証する人工知能の一種です。基本的に、このテクノロジーはアルゴリズムを使用して画像またはビデオ内の顔を検出します。次に、目の間の距離、顎の形、頬骨の輪郭など、顔のさまざまな側面を測定します。

これらの測定値は数式に変換され、 「顔のサイン」、既知の顔のデータベースと比較して一致するものを見つけることができ、セキュリティ システムから携帯電話のロック解除、ソーシャル メディア上の友人のタグ付けまで、さまざまなアプリケーションで使用できます。

公的部門と民間部門の両方で顔認識技術の使用が増加するにつれ、これらのツールが個人の属性の予測など、単純な識別を超えた目的に使用される可能性が高まります。たとえば、これもそうですが、政治的方向性です。

政治的方向性の予測: 研究

雑誌に掲載された彼らの新しい研究では アメリカの心理学者 (ここにリンクします)、以下の研究者が率いる ミハル・コシンスキ、スタンフォード大学の組織行動学の准教授は、特定の先導に従いました。ターゲット?政治的指向を予測する際に顔の特徴のみの影響を分離する。この研究では、表情や頭の向きなどの変数に焦点を当てました。

これを行うには、 彼らは591人の参加者を募集した 大規模な私立大学からの学生が参加し、高度に管理された環境で写真を撮影しました。被験者は全員黒いTシャツを着ており、化粧を落とし、髪を後ろにまとめていました。写真は、明るい部屋で、中間色の背景に対して、固定位置で撮影されました。

次に、画像は顔認識アルゴリズムによって処理され、数値的な「顔の記述子」が抽出されました。これらの記述子は、顔の特徴をコンピューター分析可能な形式にエンコードします。そして、それらは、参加者を政治的指向スケールにマッピングするモデルを通じて、参加者の政治的指向を予測するために使用されました。

AIは人間よりも政治的指向を正確に推測します

結果?彼らは素晴らしいです。顔認識アルゴリズムは政治的指向を予測できた 相関係数は 0,22 でした。 控えめではあるものの、この相関関係は統計的に有意であり、安定した顔の特徴の一部が、他の人口統計的要因とは無関係に、政治的指向に関連している可能性があることを示唆しています。

Ma nonètutto。 第 2 ステップとして、研究者らはアルゴリズムを置き換えました。 1.026 人の人間の評価者と、 同じ標準化された画像から政治的方向性を推定するよう依頼します。驚くべきことに、人間もアルゴリズムと同等の精度で政治的方向性を予測することができました。 相関係数は 0,21 です。 要するに、少し調子が悪いです。

ついに第3フェーズへ研究者らは、より現実世界のシナリオで結果を検証するために、モデルを政治家の一連の画像に適用しました。ここでも、顔認識モデルは政治的指向をかなりの精度で予測できました。予測的な顔の特徴の一部は、より多様な画像でも識別できることを実証します。

将来への影響: 前例のない脅威

この研究結果はプライバシーに関する重大な懸念を引き起こします。顔認識は被験者の同意や知識がなくても使用できます。

顔画像は法執行機関によって簡単に(そして秘密裏に)撮影されたり、ソーシャル ネットワーク、出会い系プラットフォーム、写真共有サイト、政府データベースなどのデジタル アーカイブや従来のアーカイブから取得されたりする可能性があります。これらは多くの場合簡単にアクセスできます。たとえば、Facebook や LinkedIn のプロフィール写真は、本人の同意や知識なしに誰でも閲覧できます。

したがって、顔認識技術によってもたらされるプライバシーの脅威は、多くの点で前例のないものです。そして、公共部門と民間部門の両方でこれらのツールの使用が増えるにつれて、悪用と大規模な監視のリスクがますます現実的になります。

顔認識の未来: 投票権と顔の権利

の研究 コシンスキー とその同僚たちは、顔認識テクノロジーを使用して、私たちの同意や知識なしに、政治的志向などの私たちのアイデンティティの親密な側面を明らかにできる可能性がある未来への窓を開きます。しかし、それは多くの倫理的な疑問や課題も引き起こします。

セキュリティの向上やサービスのパーソナライズなど、このテクノロジーの潜在的な利点と、プライバシーや個人の自由に対するリスクとのバランスをどのように取ることができるでしょうか?これらのツールが目的外に使用されていないことを確認するにはどうすればよいですか 差別的または抑圧的、特に少数派や弱い立場のグループに対して?

これらの質問に対する簡単な答えはありません。しかし、私たちはできるだけ早くそれらを探さなければなりません。なぜなら、毎朝鏡に映る顔は、分析され分類されるべき単なる生体特徴の集合ではないからです。それは私たちの人間性、個性、思想と表現の自由を反映しています。

そして、これらは、どれほど洗練されたアルゴリズムであっても、決して制御する必要のない値です。