モニターやテクノロジー機器があふれる明るい環境の中で、ロボットが主役として立っています。金属組織は光を反射しますが、本当の魔法はその「目」に隠されています。これらの目は、DeepMind の RT-2 モデルによって強化されており、見て、解釈し、行動することができます。

ロボットが優雅に動くと、周囲の科学者たちはロボットの一挙手一投足を注意深く観察します。それは単なる金属片や回路ではなく、ウェブの広大な世界と具体的な現実を結び付ける知性の具現化です。

RT-2の進化

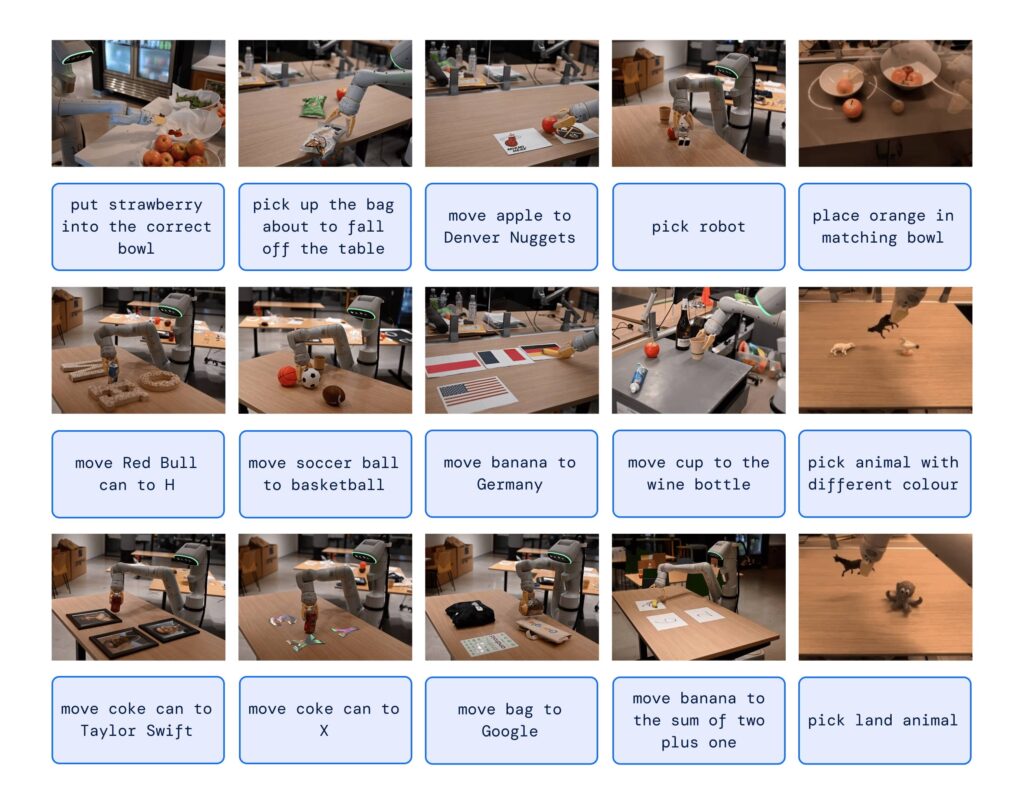

ロボット工学は近年大きく進歩していますが、 ディープマインド それはゲームをまったく新しいレベルに引き上げただけです。 イラスト付き 論文で 発売したばかりです、届きました RT-2。もの?これは、Web データだけでなくロボット データからも学習し、この知識をロボット制御の一般化された命令に変換するビジョン言語アクション (VLA) モデルです。

テクノロジーが飛躍的に進歩する時代において、RT-2 は大きな飛躍を遂げ、ロボット工学の分野だけでなく、私たちの日常の生活や働き方にも革命をもたらすことを約束します。しかし、これは実際には何を意味するのでしょうか?

DeepMind RT-2、ビジョンからアクションへ

のモデル 高容量ビジョン言語 (VLM) 彼らは大規模なデータセットでトレーニングされているため、視覚的または言語的パターン (たとえば、異なる言語で動作する) を認識することにも非常に優れています。 しかし、これらのモデルと同じことをロボットに実行させることができると想像してみてください。 実際、想像するのはやめてください。DeepMind は RT-2 でそれを可能にしています。

ロボットトランスフォーマー1 (RT-1) それ自体が驚異でしたが、RT-2 はさらに進化し、強化された汎化機能と、これまでさらされてきたロボット データを超えた意味論的および視覚的理解を示しています。

連鎖推論

RT-2 の最も魅力的な側面の XNUMX つは、その連鎖推論能力です。 彼は、どんな物体がその場しのぎのハンマーとして使えるか、あるいは疲れた人にはどんな飲み物が最適かを決めることができる。 この深い推論能力は、私たちがロボットと対話する方法に革命をもたらす可能性があります。

そして最悪なことに、頭の明晰さを取り戻すためにロボットにおいしいコーヒーを入れてもらうこともできます。

しかし、DeepMind RT-2 はどのようにしてロボットを制御するのでしょうか?

答えは彼がどのように訓練されたかにあります。 実際、ChatGPT などのテンプレートによって利用される言語トークンと似たような表現が使用されています。

RT-2 は、シンボルの理解、推論、人間の認識などの驚くべき創発能力を実証しました。 現在、以前のモデルと比較して3倍以上の向上を示しているスキル。

RT-2では、 ディープマインド これは、視覚言語モデルを強力な視覚言語行動モデルに変換できることを示しただけでなく、ロボットが推論し、問題を解決し、情報を解釈して現実のさまざまなタスクを実行できる未来への扉も開きました。世界。

そしていま?

人工知能とロボット工学がますます中心となる世界において、RT-2 は次の進化が純粋に技術的なものではなく、「知覚」的なものになることを示しています。機械は私たちが想像もしていなかった方法で私たちのニーズを理解し、それに応えてくれるでしょう。

これがほんの始まりに過ぎないとしたら、将来どうなるかは誰にもわかりません。