この投稿は、Linkedinニュースレター「Periscopio」の一部であり、毎週将来の将来の問題を調査し、LinkedInプラットフォームで事前に公開されています。 購読してプレビューしたい場合は、 ここですべてを見つけてください。

機械があらゆる方法で人類と協力する、完全にロボットの世界は、書籍、映画、ゲームなどの SF 作品で長年にわたって繰り返し登場してきました。そしていつものように、それは二極化された方法で語られます。

私たちは、機械が廃棄物やスクラップの中から失われた人生の意味を探すのを助ける世界的な埋め立て地にいることに気付くのでしょうか? 人工知能 (および敵対的知能) に支配された世界滅亡後のシナリオでは? それとも、人類と機械がロボット的で漠然と無菌の平衡状態で共存する惑星でしょうか (アシモフのように理解してください)?

私たちが思い描く未来の形

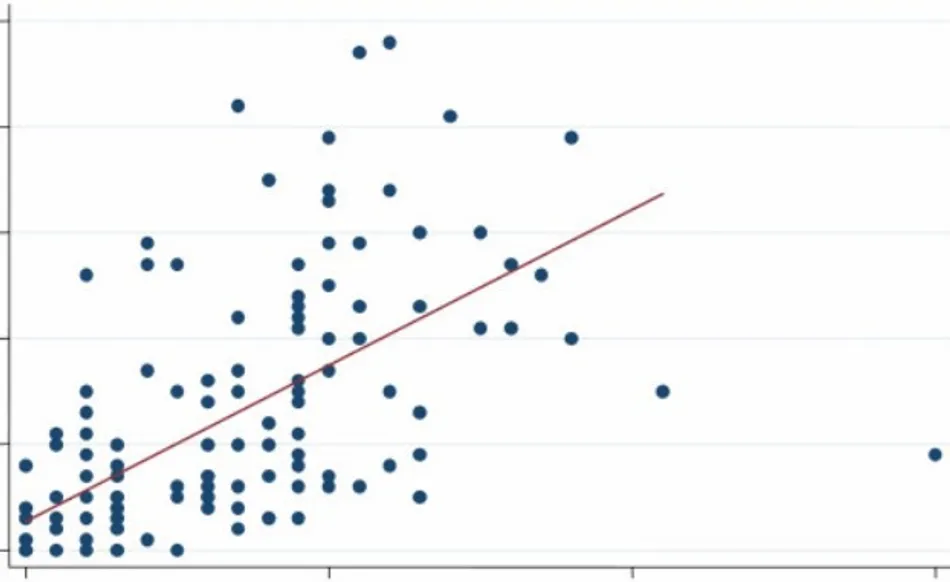

ロボットの未来のすべてのバージョンを XNUMX つのグラフにまとめると、次のようになります。

それを否定しないようにしましょう。私たちの見解のほとんどは悲観的です。 私たちは最悪の事態を恐れる権利がありますか? 比較してみましょう ロボット工学 と研究人工知能 (今後ますます密接に連携して)同様の規模の他のテクノロジーの進歩と連動します。とりわけ例としては、原子力の研究があります。彼らは軍事計画によって推進された爆弾から始まりました。 そして、今日何が起こると思いますか?

新しいものは何もありません。 不運にも。

今日、ロボット工学と AI の分野で働くすべての関係者は、人間の命に特権を与える正確な倫理規則に従って機械を設計する必要があることに一般的に同意しています。人工知能を備えたロボット装置は、人間を認識し、危害を加えないようにすることができなければなりません。 どんな犠牲を払っても。

本当にこんな感じ? 私があなたに書いているように、米国、ロシア、中国、その他の国はすべて、人を殺すための AI 駆動のドローンやフィールドロボットを作成 (および配備) するプログラムを実施しています。

下のビデオにあるロボットと同様のロボットは、自分自身を「指示」できるようになります。

それは劇的な再発です: もう一度言いますが、私たちはロボットの時代に入る前から、これらの問題について何年も考え続けてきた二世代の科学者や未来学者のアドバイスを無視しています。無駄に?

私たちが望むロボットの世界は別のものです

「私たち国民は」、誰かが言うでしょう、私たちは地球が支配されることを望んでいません。 キラーロボット。 私たちは心ではディストピアを恐れ、心ではユートピアを望みます。

私たちは、ロボットと人工知能がすべてをより良くするのに役立つ世界を望んでいます. しかし、軍事目標が再びロボットの未来を動かしている場合、そこに到達するには地獄を通過する可能性があります.

サイエンス フィクションを決して過小評価しないでください。 未来を刺激するだけでなく、現在の写真も撮ります。私たちのSFの多くが、自己認識を持ち、世界を征服したり人間を排除しようとしたりするロボットを中心に展開しているのには理由があります。

これが可能性であることは認識していますが、機械のせいではありません。 それは私たちのものだ。 私たちは、自分自身を危険にさらす新しい方法を常に見つけることに長けています。 それは私たちの種への不信ですか? または、その限界についての深い知識はありますか? 両方のこと。

災害を避けるXNUMXつの方法

人工知能に関するすべての研究を放棄または禁止しますか? おそらくうまくいかないでしょう。 核兵器を制御しようとする試みや、倫理的に疑わしい医学研究と同じように。

同意する人もいるでしょうが、多くの人は同意しません。好奇心を満たし、他人よりも優位に立ちたいという人間の欲望は、克服することができません。

第二に、教育、教育、教育。 人間と機械の教育。 誰もが潜在的な危険を理解し、社会的、政治的、文化的、そして何よりも技術的な枠組みを構築するように努めてください。

ロボットの世界が人間に敵対する場所ではない枠組み。届くかどうかは別として、 技術的特異点 それは定義上、暴力的で突然の何かであり、重要なバトンの受け渡しです。

地面をしっかり準備しなければ、コントロールを失う可能性はありません しかし、自然で突然の確信です。 機械の進化は私たちにはコントロールできなくなり、ニシローランドゴリラやジャイアントパンダと同じような立場に陥ることになるでしょう。

このため、技術者と科学者の最初の、ほとんど感動的な努力に拍手を送ります。 機械に道徳を「植え付ける」 私たち自身が尊重する方法を知らないこと。

これらのマシンが目を開けて火花を散らす前に、それを行う必要があります。それが愛の火花となるように、そしておそらくそれが私たち自身について何かを教えてくれるかもしれないように、私たちはそれをしなければなりません。